解决hugging face 下载预训练模型方法

一,前言

当使用下面类似的代码时, 模型会自动下载或加载

• 先检查本地缓存

SentenceTransformer 首先检查本地缓存目录(如 ~/.cache/huggingface/transformers)是否已存在 embedding_model_name 指定的预训练模型。

如果存在:直接加载本地缓存的模型文件(包括权重、配置、词汇表等)。

如果不存在:自动从 Hugging Face Model Hub 或其他镜像服务器下载模型文件到本地缓存。

然而这里就会出现问题,连接不上huggingface.co 因为这是外国的网站。

from sentence_transformers import SentenceTransformer

from huggingface_hub import snapshot_download

embedding_model_name="sentence-transformers/all-MiniLM-L6-v2"

print("Loading embedding model...")

embedding_model = SentenceTransformer(embedding_model_name)

print("qwen downloading.")

snapshot_download(repo_id="Qwen/Qwen2.5-VL-72B") # 换成你的模型名

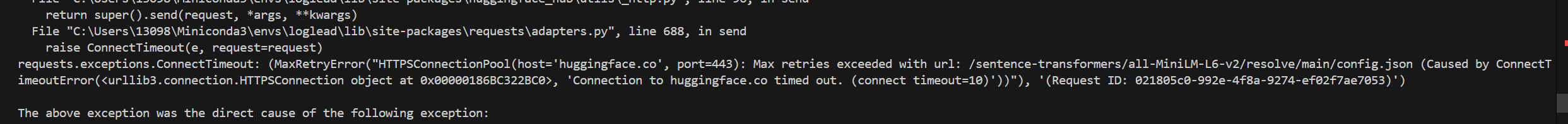

问题报错:

二,解决方法

方法一(使用代理)

***开启本地代理就行,但是这个方法不稳定,只支持自己的电脑上有VPN代理。

方法二(国内镜像)

import os

# 插入这行魔法代码⬇️

os.environ['HF_ENDPOINT'] = 'https://hf-mirror.com'

设置为国内镜像源就行。速度会很快

命令行硬核模式(Linux/Mac首选)

export HF_ENDPOINT=https://hf-mirror.com

# 带进度条监控的下载命令

huggingface-cli download --resume-download Qwen/Qwen2.5-VL-72B

没有认证的报错解决

去hugging face官网申请token 在下面代码中加入就可以正常下载了

import os

# 插入这行魔法代码⬇️

os.environ['HF_ENDPOINT'] = 'https://hf-mirror.com'

from sentence_transformers import SentenceTransformer

from huggingface_hub import snapshot_download

# 如果报错账号密码错误或者没有认证码,请先登录huggingface账号,获取token,然后替换hf_token变量的值

from huggingface_hub import login

hf_token = 'hf_xxxxx' # 这里替换成你的huggingface的token

login(hf_token)

# 下载模型

embedding_model_name="sentence-transformers/all-MiniLM-L6-v2"

print("Loading embedding model...")

# embedding_model = SentenceTransformer(embedding_model_name)

print("qwen downloading.")

snapshot_download(repo_id="Qwen/Qwen2.5-Omni-7B") # 换成你的模型名

浙公网安备 33010602011771号

浙公网安备 33010602011771号